Kennen wir uns?

MPI-Forscher entdecken direkte Verbindung zwischen den Hirnarealen für Stimm- und Gesichtserkennung

MPI-Forscher entdecken direkte Verbindung zwischen den Hirnarealen für Stimm- und Gesichtserkennung

Gesicht und Stimme sind zwei der wichtigsten Merkmale, an denen wir Personen identifizieren. Forscher am Max-Planck-Institut (MPI) für Kognitions- und Neurowissenschaften haben nun herausgefunden, dass zwischen den Gehirnarealen, die für das Erkennen von Stimmen und Gesichtern zuständig sind, eine direkte strukturelle Verbindung aus Nervenfaserbahnen besteht. Der Informationsaustausch, der so vermutlich zwischen den Arealen stattfindet, könnte uns im Alltag dabei helfen, vertraute Personen schnell und unter widrigen Bedingungen zu identifizieren.

Darüber, was im Hirn passiert, wenn wir eine bekannte Person wiedererkennen, gibt es verschiedene Theorien. Lange ging man davon aus, dass Stimm- und Gesichtserkennung zunächst getrennt voneinander ablaufen und erst später auf einer höheren Verarbeitungsebene zusammengeführt werden. Seit einigen Jahren mehren sich jedoch die Hinweise darauf, dass Stimm- und Gesichtserkennung viel direkter miteinander zusammenhängen. Katharina von Kriegstein, Leiterin der Max-Planck-Forschungsgruppe "Neuronale Mechanismen zwischenmenschlicher Kommunikation", konnte zeigen, dass schon beim bloßen Hören einer bekannten Stimme Gebiete des Gehirns aktiv werden, die eigentlich für die Identifikation von Gesichtern zuständig sind. Diese Aktivierungen gingen mit besseren Ergebnissen beim Erkennen der Stimmen einher.

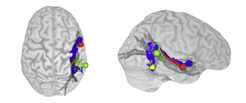

„Wir gehen inzwischen davon aus, dass Areale im Gehirn, die in Stimm- und Gesichtserkennung involviert sind, direkt miteinander interagieren und sich gegenseitig beeinflussen“, sagt Helen Blank. In einer aktuellen Studie gelang es der Mitarbeiterin in von Kriegsteins Forschungsgruppe nun, auch auf anatomischer Ebene eine Verbindung zwischen Stimm- und Gesichtserkennungsarealen nachzuweisen. Dafür nutzte sie die diffusionsgewichtete Magnetresonanztomografie - ein Verfahren, mit dem sich, wenn es mit der mathematischen Modellierungstechnik der Traktografie kombiniert wird, der Verlauf von Nervenfaserverbindungen im Hirn rekonstruieren lassen. Die für Stimm- und Gesichtsidentifikation zuständigen Areale hatte Blank zuvor bei ihren Probanden lokalisiert, indem sie die Reaktionen des Gehirns auf verschiedene Stimmen und Gesichter mithilfe funktioneller Magnetresonanztomografie gemessen hatte.

Zwischen den Arealen für Stimmerkennung und dem Gesichtserkennungsareal entdeckte Blank eine direkte Verbindungen aus Nervenfaserbahnen. „Besonders interessant ist, dass das Gesichtserkennungsareal stärker mit den Arealen für Stimmerkennung verbunden zu sein scheint, die Stimmen identifizieren können. Und das, obwohl diese weiter entfernt liegen als Areale, die akustische Information von Stimmen auf einer eher allgemeineren Ebene verarbeiten“, sagt die Forscherin.

Im Alltag könnte diese direkte Verbindung in unserem Gehirn genutzt werden, um das Gesicht unseres Gesprächspartners zu simulieren, wenn wir z.B. am Telefon mit einer bekannten Person sprechen. Noch ist allerdings offen, welche Informationen es genau sind, die zwischen den Hirnarealen ausgetauscht werden. Diese Frage soll in einer kommenden Studie geklärt werden, die Blank derzeit vorbereitet.

Genauer zu verstehen, wie das Gehirn bei so grundsätzlichen Aufgaben wie der Personenerkennung arbeitet, kann für viele Bereiche von Nutzen sein. „Der Fund ist unter anderem interessant für die Erforschung neurologischer Besonderheiten wie Prosopagnosie und Phonagnosie, bei denen es Menschen nicht gelingt, andere Personen an ihrem Gesicht oder an ihrer Stimme zu erkennen“, sagt Blank. Außerdem könnten die neuen Erkenntnisse Innovationen in der Computertechnik anstoßen, um die Personenerkennung von Maschinen zu verbessern.